La Rédaction

Démocratie Participative

15 mai 2025

L’IA peut déterminer la race d’un individu en analysant son rythme cardiaque.

C’est ce que révèle ce chercheur qui ensuite explique pourquoi la race n’est pas une réalité biologique.

Imaginez un modèle d’IA capable d’utiliser un scanner cardiaque pour deviner dans quelle catégorie raciale vous êtes susceptible d’être placé – même si on ne lui a pas dit ce qu’est une race, ni ce qu’il faut rechercher. Cela ressemble à de la science-fiction, mais c’est bien réel.

L’étude que j’ai menée récemment avec des collègues a révélé qu’un modèle d’IA pouvait deviner si un patient s’identifiait comme noir ou blanc à partir d’images cardiaques avec une précision allant jusqu’à 96 %, même si aucune information explicite sur les catégories raciales n’avait été donnée.

Cette découverte frappante remet en question les hypothèses sur l’objectivité de l’IA et met en lumière un problème plus profond : Les systèmes d’IA ne se contentent pas de refléter le monde, ils absorbent et reproduisent les préjugés qui y sont intégrés.

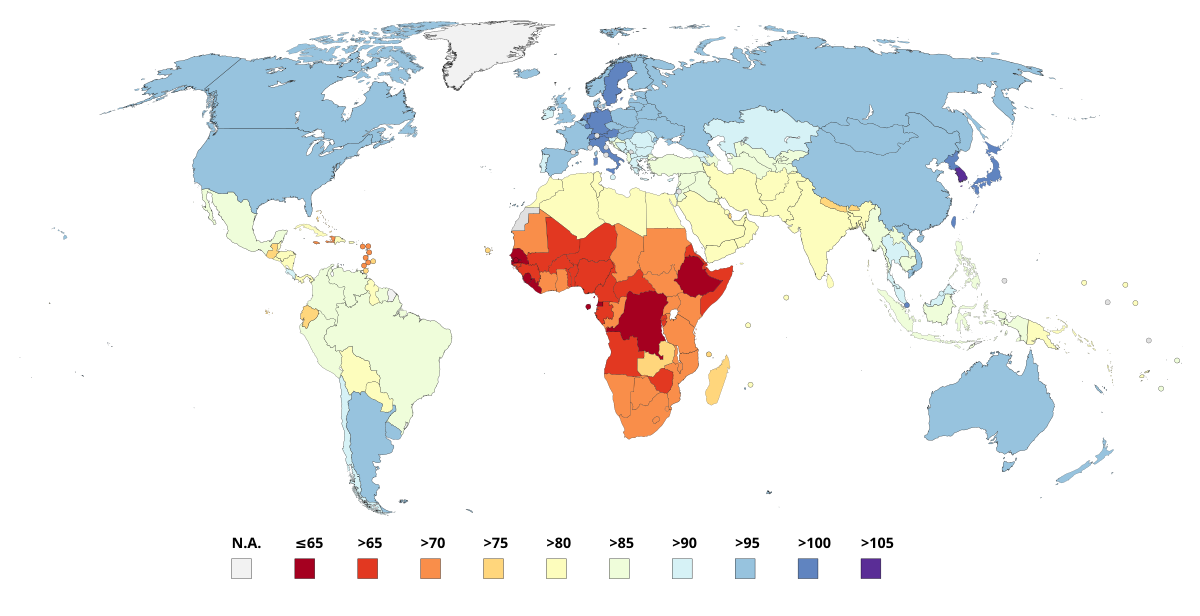

Tout d’abord, il est important d’être clair : la race n’est pas une catégorie biologique. La génétique moderne montre qu’il y a plus de variations au sein des groupes raciaux supposés qu’entre eux.

La quantité de variations génétiques au sein d’une race n’a aucune importance face à la qualité des variations entre les races.

Ces variations suffisent à fixer les nègres dans le néolithique pour des millions d’années.

La suite est exceptionnelle de terrorisme intellectuel.

La race est une construction sociale, un ensemble de catégories inventées par les sociétés pour classer les gens sur la base de traits physiques et d’ascendances perçus. Ces classifications ne correspondent pas exactement à la biologie, mais elles influencent tout, de l’expérience vécue à l’accès aux soins.

Malgré cela, de nombreux systèmes d’IA apprennent aujourd’hui à détecter ces étiquettes sociales, et potentiellement à agir en conséquence, parce qu’ils sont construits à partir de données façonnées par un monde qui traite la race comme s’il s’agissait d’un fait biologique.

Étiquette sociale aborigène inventée par les racistes

Étiquette sociale germanique inventée par les racistes

Les systèmes d’IA transforment déjà les soins de santé. Ils peuvent analyser les radiographies du thorax, lire les scanners cardiaques et signaler les problèmes potentiels plus rapidement que les médecins humains – dans certains cas, en quelques secondes au lieu de quelques minutes. Les hôpitaux adoptent ces outils pour améliorer l’efficacité, réduire les coûts et normaliser les soins.

Mais aussi sophistiqués soient-ils, les systèmes d’IA ne sont pas neutres. Ils sont formés à partir de données réelles – et ces données reflètent les inégalités du monde réel, notamment celles fondées sur la race, le sexe, l’âge et le statut socio-économique. Ces systèmes peuvent apprendre à traiter les patients différemment en fonction de ces caractéristiques, même si personne ne les programme explicitement dans ce sens.

Les données d’apprentissage déséquilibrées constituent une source majeure de biais. Si un modèle apprend principalement à partir de patients à la peau claire, par exemple, il peut avoir du mal à détecter des pathologies chez des personnes à la peau plus foncée. Des études en dermatologie ont déjà mis en évidence ce problème.

Sauf que dans ce cas, l’IA n’avait aucune information sur la couleur de peau des patients.

Pourquoi l’a-t-il détecté sur la seule base du rythme cardiaque ?

Même les modèles de langage comme ChatGPT ne sont pas à l’abri : une étude a montré que certains modèles reproduisent encore des croyances médicales obsolètes et fausses, comme le mythe selon lequel les patients noirs ont une peau plus épaisse que les patients blancs.

Les Noirs ont la peau plus épaisse que les Blancs, de l’ordre de 10% dans certaines zones du corps, cette différence passe à 20% avec les Asiatiques.

C’est en raison d’une densité plus élevée de mélanocytes et d’une couche externe de l’épiderme plus compacte.

N’importe qui peut le voir d’un seul coup d’oeil.

Ce papier absurde a été écrit par une certaine Tiarna Lee, du King’s College de Londres, la même université qui avait assuré à la planète entière que le COVID19 allait tuer la moitié de l’humanité.

Elle a des billes dans la discussion.

Ces Noirs et ces gauchistes blancs qui peuplent les universités occidentales peuvent tenter de saboter l’IA tant qu’ils le voudront, les Chinois de leur côté passeront outre et développeront des IA résolument objectives, donc racistes car le racisme n’est que le constat de la réalité empirique : les races existent et elles sont inégales.

Démocratie Participative Le site le plus censuré d'Europe

Démocratie Participative Le site le plus censuré d'Europe